本站5月9日消息,騰訊混元宣布今天正式推出并開源全新的多模態(tài)定制化視頻生成工具HunyuanCustom。

據(jù)悉,該模型基于混元視頻生成大模型(HunyuanVideo)打造,主體一致性效果超過現(xiàn)有的開源方案。

據(jù)介紹,HunyuanCustom融合文本、圖像、音頻、視頻等多模態(tài)輸入生視頻的能力,是一款具備高度控制力和生成質(zhì)量的智能視頻創(chuàng)作工具。

騰訊表示,HunyuanCustom模型能實(shí)現(xiàn)單主體視頻生成、多主體視頻生成、單主體視頻配音、視頻局部編輯等能力,其生成的視頻與用戶輸入的參考主體能保持高度一致。

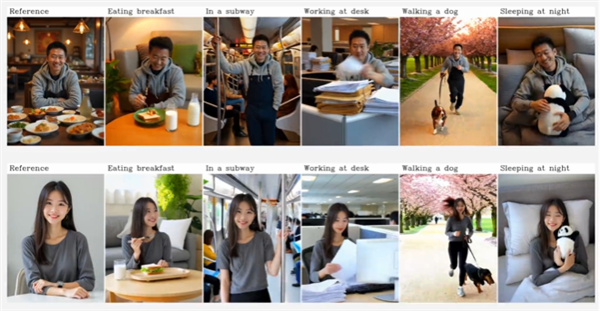

在部分場景下,創(chuàng)作者希望保持人物一致的情況下,改變?nèi)宋锼诘沫h(huán)境和動作。

但此前的視頻生成模型都無法實(shí)現(xiàn)。

而HunyuanCustom通過引入身份增強(qiáng)機(jī)制和多模態(tài)融合模塊,真正實(shí)現(xiàn)“圖像提供身份,文本定義一切”。

HunyuanCustom可以滿足視頻創(chuàng)作者、短視頻博主、電商從業(yè)者、廣告創(chuàng)意人等不同用戶和場景的需求。

比如,在廣告場景中,可以快捷變換商品背景、模特可以快速換衣服;在電商和客服場景中,可以快速低成本制作出生動的數(shù)字人商品介紹視頻,或者制作特定穿著的數(shù)字人客服視頻;在影視場景中,快速制作短劇和小故事短視頻。

此外,通過業(yè)內(nèi)領(lǐng)先的主體一致性建模能力,HunyuanCustom在單人、非人物體、多主體交互等多種場景,都能保持身份特征在視頻全程的一致性與連貫性。人物不會“變臉”,物體不會“漂移”。

目前,單主體生成能力已經(jīng)開源并在混元官網(wǎng)上線,用戶可以在“模型廣場-圖生視頻-參考生視頻”中體驗(yàn),其他能力將于5月內(nèi)陸續(xù)對外開源。

單主體生成能力下,用戶只需上傳一張目標(biāo)人物或物體的圖片,并提供一句如“他正在遛狗”的文本描述,Hunyuan Custom就能在完全不同的動作、服飾與場景中生成連貫自然的視頻內(nèi)容。

在多主體視頻的生成中,用戶提供一張人物和一張物體的照片,并輸入文字描述,即可能讓這兩個主體按要求出現(xiàn)在視頻里。

而Hunyuan Custom不止于圖像和文本的配合,還具備強(qiáng)大的擴(kuò)展能力。

在音頻驅(qū)動(單主體)模式下,用戶可以上傳人物圖像并配上音頻語音,模型便可生成人物在任意場景中說話、唱歌或進(jìn)行其他音視頻同步表演的效果,廣泛適用于數(shù)字人直播、虛擬客服、教育演示等場景。

在視頻驅(qū)動模式下,Hunyuan Custom支持將圖片中的人物或物體自然地替換或插入到任意視頻片段中,進(jìn)行創(chuàng)意植入或場景擴(kuò)展,輕松實(shí)現(xiàn)視頻重構(gòu)與內(nèi)容增強(qiáng)。

鄭重聲明:本文版權(quán)歸原作者所有,轉(zhuǎn)載文章僅為傳播更多信息之目的,如作者信息標(biāo)記有誤,請第一時間聯(lián)系我們修改或刪除,多謝。